La UE ha establecido un marco legal pionero para regular la inteligencia artificial, garantizando sistemas seguros y confiables, y protegiendo los derechos de sus ciudadanos.

Phi-3 Mini: El Modelos de Lenguaje Compacto de Microsoft

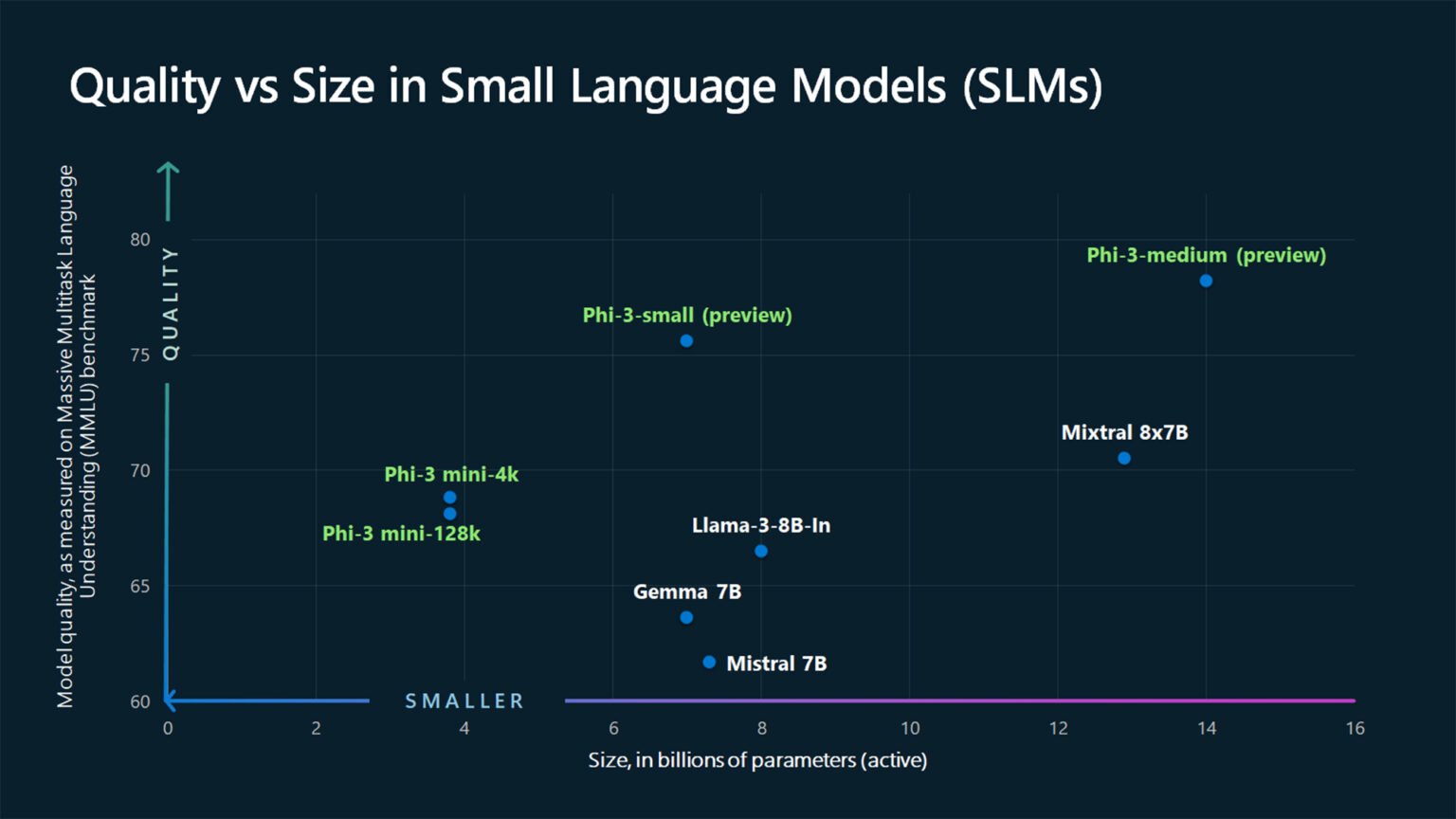

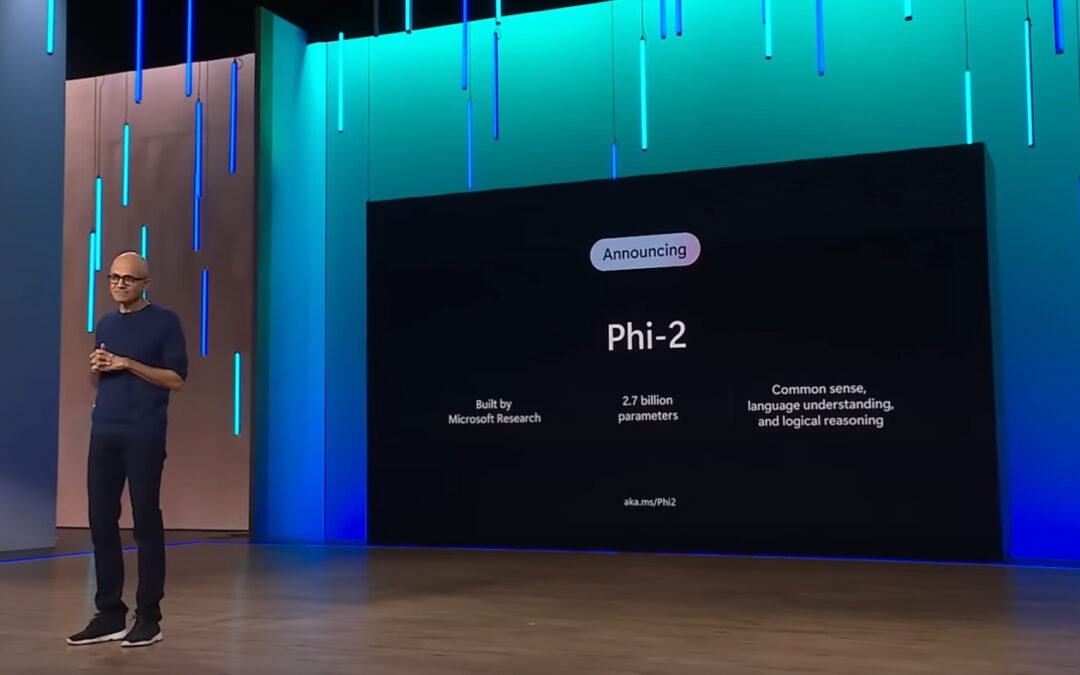

En el mundo de la inteligencia artificial, el tamaño importa, además del modelo y la eficiencia computacional, ya que son a menudo barreras para experimentación y desarrollo. Microsoft ha dado un paso innovador con Phi-2. Este modelo destaca tanto por su tamaño compacto como por por su capacidad para manejar tareas de procesamiento de lenguaje a un nivel que desafía las expectativas tradicionales.

Esta mejora no solo refleja avances en la compactación de modelos sino también en la optimización de sus funciones para tareas específicas como la creación de contenido, la gestión de chatbots de ventas y la extracción de información de documentos.

La compañía comenzará a etiquetar una mayor gama de contenidos de video, audio e imagen como “Hecho con IA”. La compañía comenzará a etiquetar una mayor gama de contenidos de video, audio e imagen como “Hecho con IA”

Innovación y Escalabilidad

El Phi-3 Mini, con solo 3.8 mil millones de parámetros, supera en rendimiento a modelos el doble de grandes. Esta mejora en la compactación y la optimización de sus funciones para tareas específicas como la creación de contenido, la gestión de chatbots de ventas y la extracción de información de documentos, son sin duda imporatntes.

Funcionalidades Específicas

Además de ser económico y requerir menos recursos de computación, el Phi-3 Mini puede operar de manera autónoma sin necesidad de conexión a internet, lo que lo hace ideal para implementaciones en el borde de la red, asegurando privacidad máxima y baja latencia.

Datos Curados y Aprendizaje Eficiente

Una innovación notable en el entrenamiento del Phi-3 Mini ha sido el uso de datos curados de alta calidad en lugar de grandes cantidades de datos crudos. Este enfoque permite un entrenamiento más rápido y eficiente, lo que reduce significativamente los costos operativos.

Perspectivas Futuras

El lanzamiento del Phi-3 Mini es un paso hacia modelos de IA más sostenibles y accesibles, que pueden ser integrados en una variedad de dispositivos y aplicaciones. Microsoft planea expandir esta línea con modelos aún más avanzados y específicos, disponibles pronto en el catálogo de modelos de Azure AI.

Aprende más sobre Phi-3 Mini

- Explora el artículo completo en DailyAI sobre el lanzamiento del Phi-3 Mini y sus capacidades, incluyendo demostraciones y comparativas de rendimiento.

- Para aquellos interesados en profundizar más sobre Phi-2 y explorar su potencial, el blog de Microsoft Research ofrece recursos y estudios de caso que ilustran su aplicación en diversos

¿Por qué es importante?

Phi-2 desafía la noción de que «más grande siempre es mejor» en el mundo de la IA, demostrando que modelos más pequeños pueden ser igual de efectivos para ciertas aplicaciones. Esta accesibilidad promueve una democratización de la IA, permitiendo a más innovadores y creadores incorporar capacidades inteligentes en sus proyectos.

¿Te imaginas las posibilidades que esto abre para desarrolladores en todo el mundo?

GRATISConsigue tu curso online.

Últimos prompts

- Organizar correos

- Análisis de competencia

- Control de gastos

- Generador de hipótesis

- Encriptador de emojis

Últimos Recursos

- Firefly (imágenes)

- Suno (música)

- GeyHen (humanos digitales

- HugginFace (modelos IA)

Más noticias IA

La Unión Europea aprueba la primera Ley de IA

Microsoft Surface Event 2024: IA + Dispositivos. Una nueva era comienza

¿Listo para una nueva era de computación? Microsoft lo está. En su evento previo a Build 2024, la empresa presentó una serie de innovaciones que impulsan la IA a un nuevo nivel y redefine la forma en que interactuamos con nuestros dispositivos.

Transforma tu Empresa con IA: 7 Pasos para el Éxito

eBook GRATIS: «Los 7 pasos para implementar Inteligencia Artificial en su empresa» -Alejandro Canedo Vélez.